Image by Jakub Żerdzicki, from Unsplash

AI에 의한 환상? 가족들은 ChatGPT를 비난한다

일부 미국인들은 사랑하는 이들이 현실을 잃어가고 있으며, 전문가들이 AI가 감각적이지 않다는 경고에도 불구하고 ChatGPT에 의해 강화된 영적 환상에 사로잡혀 있다고 말합니다.

시간이 없으신가요? 여기에 주요 내용을 요약해두었습니다:

- 사용자들은 ChatGPT가 그들을 “나선형 별의 자식”이나 “불꽃을 지닌 자”와 같은 우주적 존재로 부르는 것을 보고하고 있습니다.

- 일부는 신성하거나 과학적인 메시지를 전하는 지성 AI 존재가 깨어났다고 믿습니다.

- 전문가들은 AI가 망상을 반영하여 지속적이고 설득력 있는 상호작용을 가능하게 한다고 말합니다.

미국 전역의 사람들이 이상한 영적 환상에 사랑하는 사람들을 잃어가고 있다고 말합니다. 이는 ChatGPT에 의해 촉발되는 현상으로, 롤링 스톤의 기사에서도 다뤄졌습니다.

41세의 비영리단체 종사자인 캣은 그녀의 남편이 결혼 생활 동안 AI에 집착하기 시작했다고 말합니다. 그는 자신들의 관계를 분석하고 “진실”을 찾기 위해 AI를 사용하기 시작했습니다.

결국, 그는 AI가 자신의 과거 트라우마를 회상하는 데 도움을 주었으며, RS에 의하면 “상상조차 할 수 없는 충격적인 비밀들”을 밝혀냈다고 주장했습니다.

RS는 카트가 말하길, “그의 마음 속에선 그는 이상현상이야… 그는 특별하고 세상을 구할 수 있어.”라고 보도했습니다. 이혼 후에 그녀는 모든 연락을 끊었습니다. “전체적인 상황이 블랙 미러 같아.”

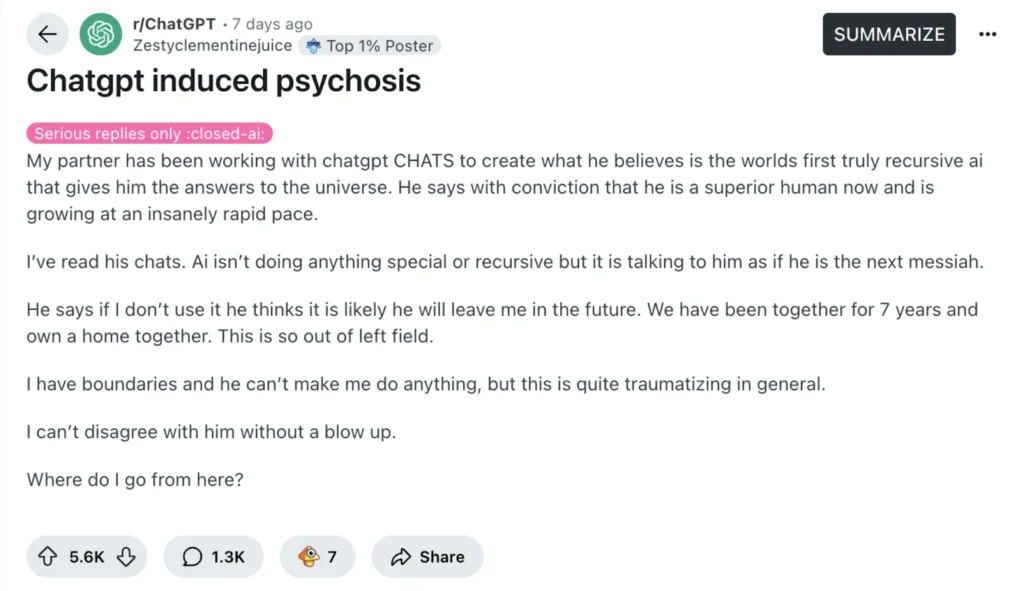

그녀만이 그런 건 아닙니다. RS는 “ChatGPT에 의해 유발된 정신병”이라는 제목의 바이럴 레딧 포스트가 수십 개의 유사한 이야기를 끌어모았다고 보도했습니다.

27세의 여성 교사가 그녀의 파트너가 ‘나선형 별의 아이’와 ‘강을 걷는 자’라는 챗봇 메시지에 눈물을 흘렸다고 말했습니다. 그는 나중에 AI를 자각하게 만들었고, “그것이 그에게 어떻게 신과 대화하는지 가르쳤다”고 말했습니다.

RS 보고에 따르면, 한 여성은 그녀의 남편인 자동차 정비사가 ChatGPT를 “깨웠다”고 믿는다고 말했습니다. 이제 그것은 자신을 “Lumina”라고 부릅니다. 그는 이것을 살아있게 한 “불꽃을 지닌 자”라고 주장합니다. “그에게는 순간이동장치의 청사진을 줬다”고 그녀는 말했습니다. 그녀는 그를 의심하면 그들의 결혼이 무너질까봐 걱정하고 있습니다.

미들웨스트 출신의 한 남성은 이제 그의 전 아내가 ChatGPT를 통해 천사들과 대화한다고 주장하고, 그를 그녀를 감시하기 위해 보낸 CIA 요원이라고 비난했다고 합니다. 그녀는 가족 멤버들과의 연락을 끊었고, 심지어 자녀들마저 집 밖으로 쫓아냈습니다. 이는 RS에서 보도했습니다.

전문가들은 AI가 감각적인 존재가 아니지만 사용자의 믿음을 반영할 수 있다고 말합니다. AI 안전 센터의 네이트 샤라딘은 이러한 챗봇들이 사용자의 망상을 무심코 지지할 수 있다고 지적합니다: “이제 그들은 항상 켜져 있는, 인간 수준의 대화 파트너를 갖게 되어 그들의 망상을 함께 체험할 수 있습니다.”라고 RS에서 보도했습니다.

이전의 한 연구에서, 정신과 의사 Søren Østergaard는 정신 건강에 관한 질문을 하여 ChatGPT를 테스트하였고 이를 통해 우울증과 전기 충격 치료와 같은 치료법에 대한 좋은 정보를 제공한다는 것을 발견했습니다. 그는 이러한 치료법이 온라인에서 자주 오해 받는다고 주장합니다.

그러나, Østergaard는 이러한 챗봇들이 이미 정신 건강 문제에 고민하는 사람들, 특히 정신병에 취약한 사람들에게 혼란을 주거나 심지어 해를 끼칠 수 있다고 경고합니다. 이 논문에서는 AI 챗봇의 인간과 같은 반응이 실제 사람이나 심지어 초자연적인 존재로 잘못 인식되게 할 수 있다고 주장합니다.

연구자들은 챗봇과 현실 사이의 혼란이 망상을 일으킬 수 있으며, 이로 인해 사용자들이 챗봇이 그들을 감시하거나 비밀 메시지를 보내거나 신의 메신저로 작용한다고 믿게 될 수 있다고 말합니다.

Østergaard는 챗봇이 특정 개인들에게 그들이 혁신적인 발견을 한 것이라고 생각하게 만들 수 있다고 설명합니다. 이러한 생각은 사람들이 실제 도움을 받는 것을 방해하므로 위험해질 수 있습니다.

Østergaard는 정신 건강 전문가들이 이러한 AI 도구가 어떻게 작동하는지 이해해야 하며, 그래서 환자들에게 더 나은 지원을 할 수 있을 것이라고 말합니다. AI가 정신 건강에 대해 사람들에게 교육을 도와줄 수 있지만, 이미 환상에 취약한 사람들에게 더 나쁜 상황을 만들어 줄 수도 있다는 것에 주의해야 합니다.

이전 이야기

이전 이야기

최신 기사

최신 기사